YouTube dice que tomará medidas para garantizar que la IA generativa tenga un lugar en la plataforma de vídeo, y al mismo tiempo sea responsable de ella. En una publicación de blog de esta semana, Jennifer Flannery O'Connor y Emily Moxley, vicepresidentas de gestión de productos de YouTube, compartieron varias herramientas de detección de IA que ayudarán a la plataforma de video a resaltar el contenido generado por IA.

Anuncios

Los dos dijeron que YouTube todavía se encuentra en las primeras etapas de su trabajo, pero que planea evolucionar el enfoque a medida que el equipo aprenda más. Por ahora, sin embargo, han compartido algunas formas diferentes en que la plataforma de video detectará contenido generado por IA y alertará a los usuarios sobre él para que puedan usarlo de manera responsable.

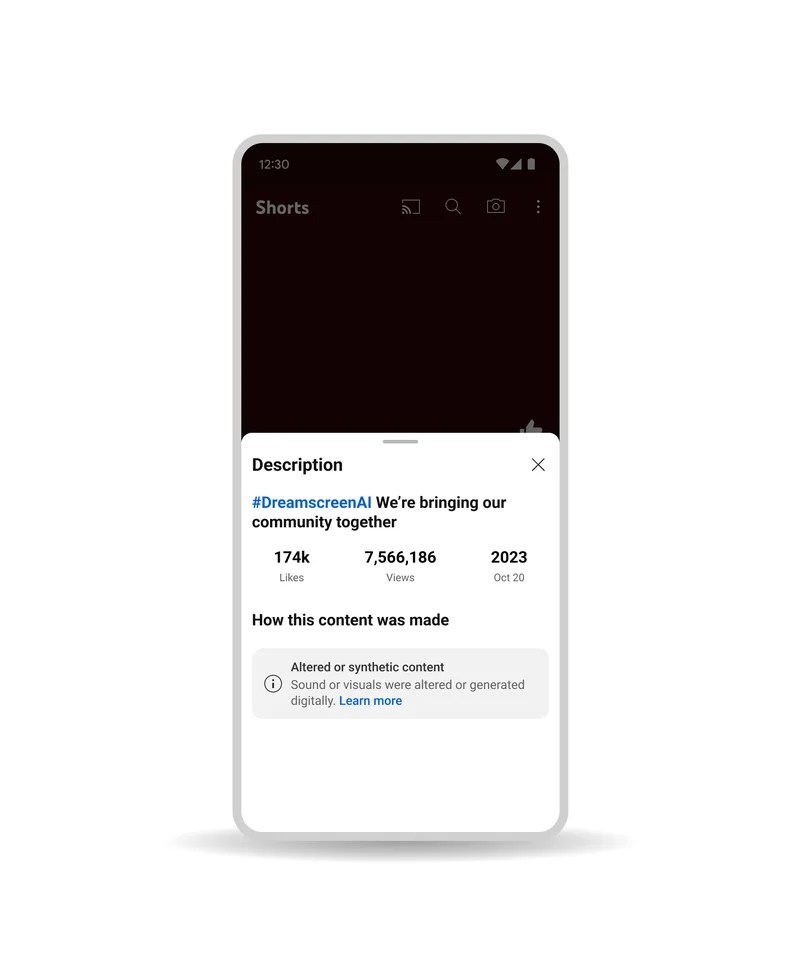

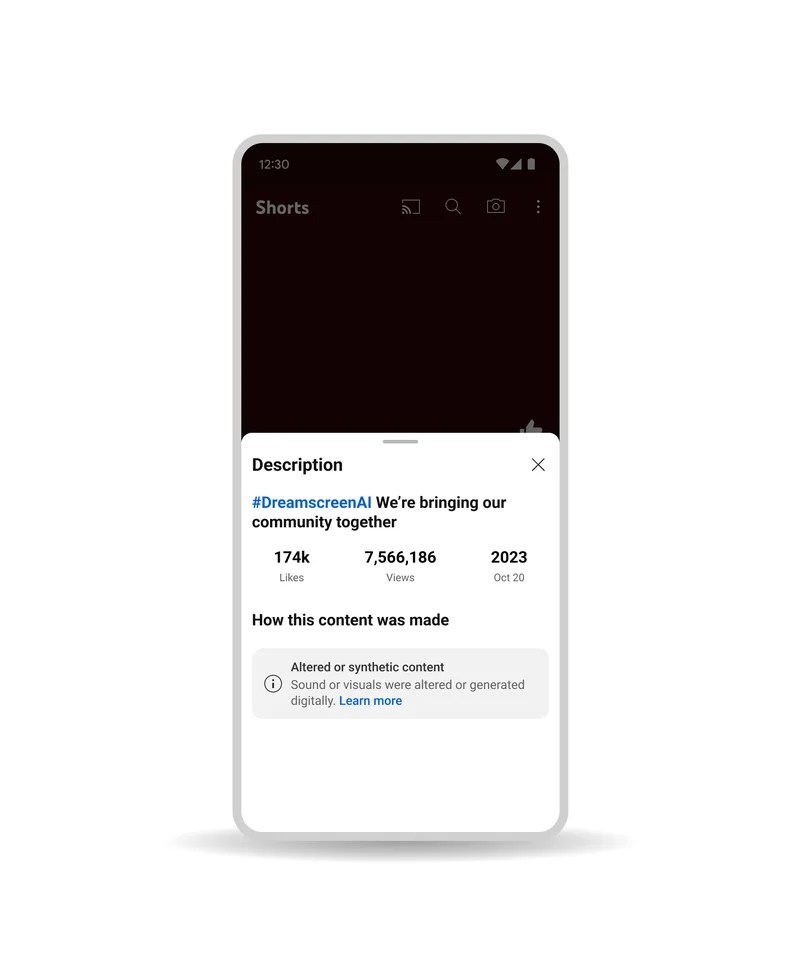

El primer método requerirá que los creadores divulguen cada vez que algo se cree utilizando IA. Esto significa que si algo en el video se creó con IA, debe tener una divulgación, así como una de varias etiquetas de contenido nuevo, que le ayuden a identificar qué se creó con IA y qué no.

Anuncios

Este problema específico se abordará mediante un sistema que indica a los espectadores cuando algo que están viendo es “sintético” o generado por IA. Si se utilizara alguna herramienta de inteligencia artificial en el video, tendría que divulgarse para ayudar a reducir la posible propagación de información errónea y otros problemas graves, señala YouTube.

YouTube dice que no se limitará a etiquetas y divulgaciones, aunque también utilizará herramientas de detección de inteligencia artificial para ayudar a seleccionar videos que muestren cosas que violen sus pautas comunitarias. Además, los dos dicen que cualquier cosa creada con los productos de inteligencia artificial generativa de YouTube será claramente etiquetada como alterada o sintética.

Además, las futuras herramientas de detección de IA de YouTube permitirán a los usuarios solicitar la eliminación de contenido alterado o sintético que simule a un individuo identificable, incluido su rostro o su voz. Esto se hará a través del proceso de solicitud de privacidad y YouTube afirma que no todo el contenido subido aquí será eliminado, pero se considerará en función de varios factores.

El contenido generado por IA llegó para quedarse, especialmente ahora que ChatGPT continúa ofreciendo tanto a tanta gente. Y aunque es poco probable que alguna vez veamos que la IA abandone por completo el medio de entretenimiento, al menos YouTube está tomando algunas medidas para ayudar a mitigar los riesgos que podría plantear a largo plazo. Por supuesto, el historial de YouTube con la vigilancia comunitaria no ha sido el mejor en el pasado, por lo que será interesante ver cómo se desarrolla todo esto en el futuro.

—————-

YouTube dice que tomará medidas para garantizar que la IA generativa tenga un lugar en la plataforma de vídeo, y al mismo tiempo sea responsable de ella. En una publicación de blog de esta semana, Jennifer Flannery O'Connor y Emily Moxley, vicepresidentas de gestión de productos de YouTube, compartieron varias herramientas de detección de IA que ayudarán a la plataforma de video a resaltar el contenido generado por IA.

Los dos dijeron que YouTube todavía se encuentra en las primeras etapas de su trabajo, pero que planea evolucionar el enfoque a medida que el equipo aprenda más. Por ahora, sin embargo, han compartido algunas formas diferentes en que la plataforma de video detectará contenido generado por IA y alertará a los usuarios sobre él para que puedan usarlo de manera responsable.

El primer método requerirá que los creadores divulguen cada vez que algo se cree utilizando IA. Esto significa que si algo en el video se creó con IA, debe tener una divulgación, así como una de varias etiquetas de contenido nuevo, que le ayuden a identificar qué se creó con IA y qué no.

Este problema específico se abordará mediante un sistema que indica a los espectadores cuando algo que están viendo es “sintético” o generado por IA. Si se utilizara alguna herramienta de inteligencia artificial en el video, tendría que divulgarse para ayudar a reducir la posible propagación de información errónea y otros problemas graves, señala YouTube.

YouTube dice que no se limitará a etiquetas y divulgaciones, aunque también utilizará herramientas de detección de inteligencia artificial para ayudar a seleccionar videos que muestren cosas que violen sus pautas comunitarias. Además, los dos dicen que cualquier cosa creada con los productos de inteligencia artificial generativa de YouTube será claramente etiquetada como alterada o sintética.

Además, las futuras herramientas de detección de IA de YouTube permitirán a los usuarios solicitar la eliminación de contenido alterado o sintético que simule a un individuo identificable, incluido su rostro o su voz. Esto se hará a través del proceso de solicitud de privacidad y YouTube afirma que no todo el contenido subido aquí será eliminado, pero se considerará en función de varios factores.

El contenido generado por IA llegó para quedarse, especialmente ahora que ChatGPT continúa ofreciendo tanto a tanta gente. Y aunque es poco probable que alguna vez veamos que la IA abandone por completo el medio de entretenimiento, al menos YouTube está tomando algunas medidas para ayudar a mitigar los riesgos que podría plantear a largo plazo. Por supuesto, el historial de YouTube con la vigilancia comunitaria no ha sido el mejor en el pasado, por lo que será interesante ver cómo se desarrolla todo esto en el futuro.